Ich habe einen Ninja-Sensor gebaut - und ihr könnt das auch

Ich habe mit Googles Teachable-Machine-Webseite eine Künstliche Intelligenz trainiert, die Ninjas entdeckt. Das geht ziemlich einfach - und ihr könnt es auch.

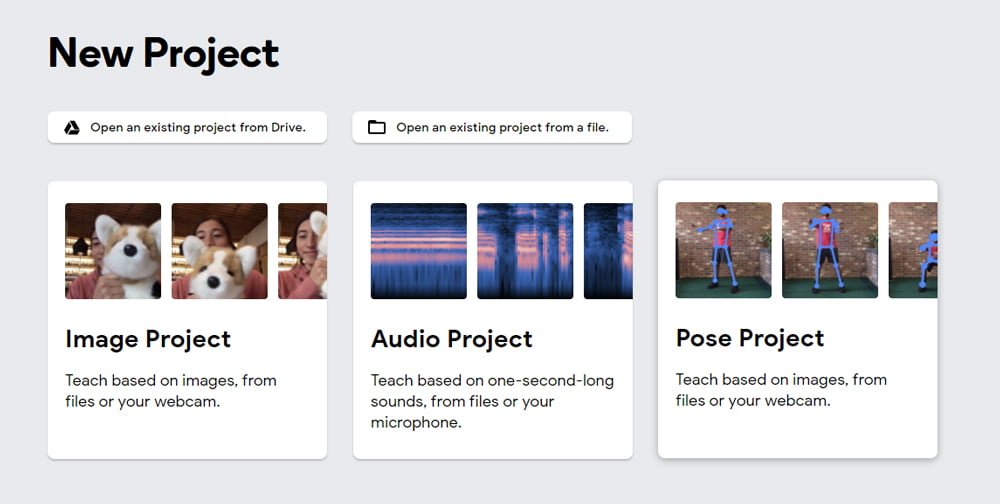

Teachable Machine ist ein Google-Projekt, mit dem ihr ohne Programmierkenntnisse eigene KI-Modelle trainieren könnt. Aktuell unterstützt Googles Projekt die KI-Erkennung von Objekten, Audio und Körperposen. Eine einfache Anleitung führt euch durch den Prozess.

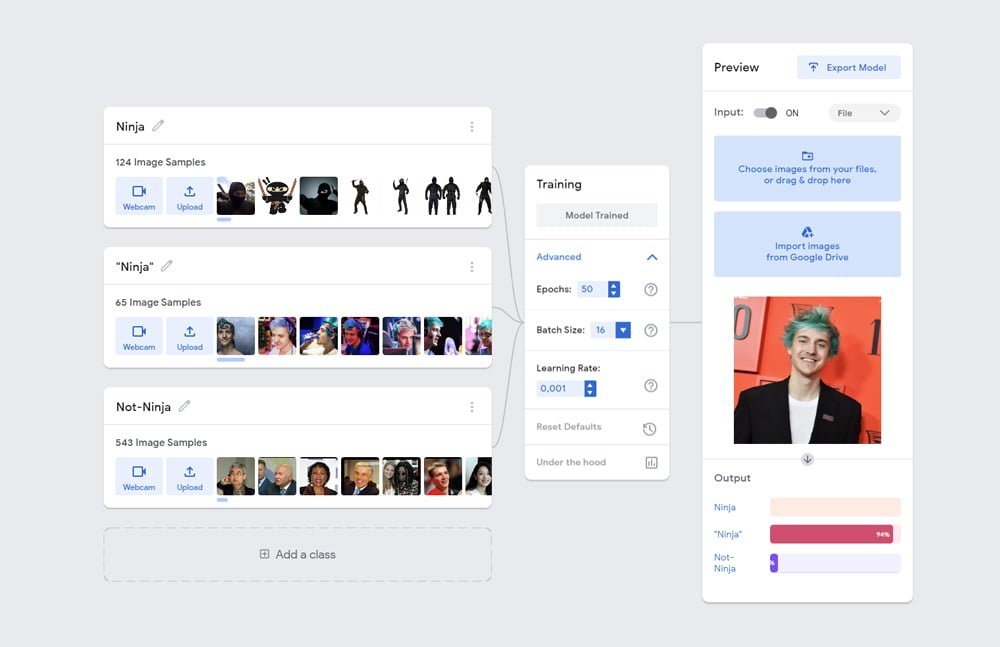

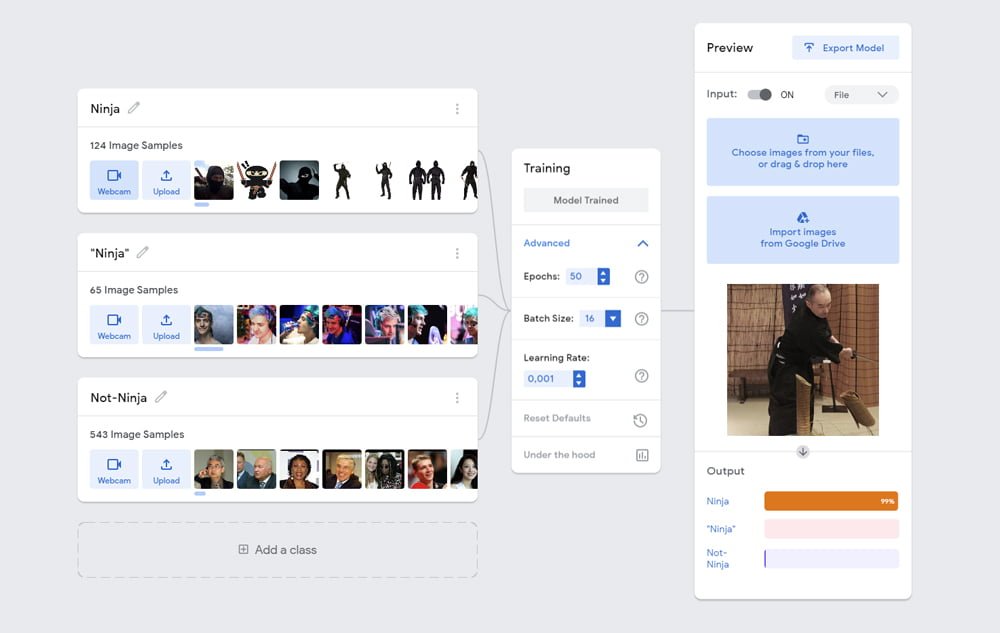

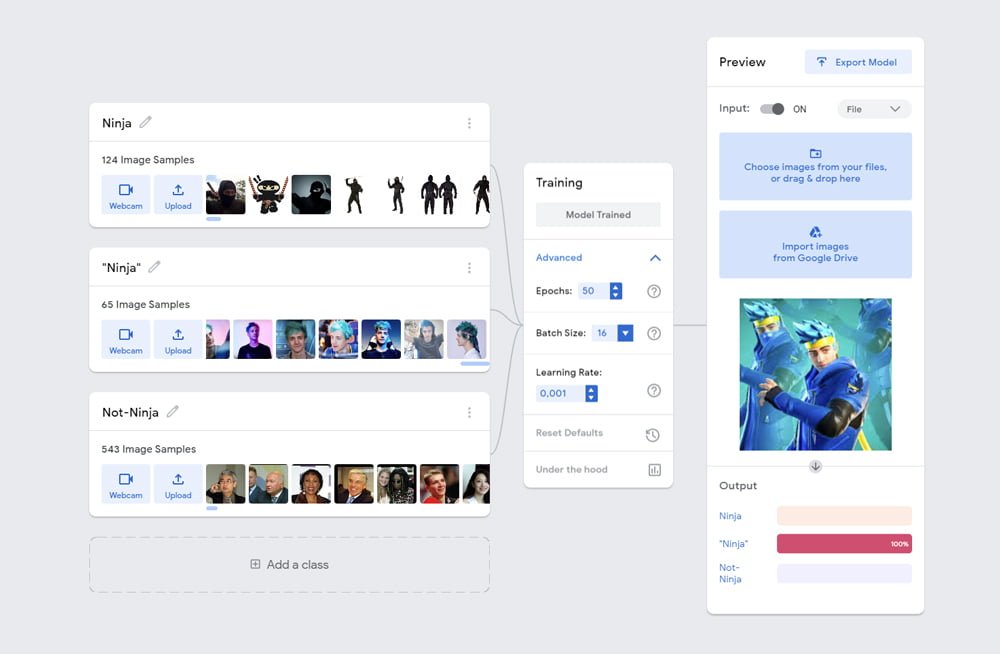

Über ein Webinterface klickt ihr Kategorien zusammen, fügt Trainingsdaten über Dateien oder Webcam hinzu und trainiert das KI-Modell anschließend lokal im Browser. Nach dem Training könnt ihr es ganz einfach testen, exportieren und mit anderen teilen oder in eigenen Projekten verwenden.

Ich habe mit Googles KI-Tool einen Ninja-Detektor trainiert: Eine Künstliche Intelligenz, die Ninjas, den Spiele-Streamer Richard Tyler Blevins alias "Ninja" und Nicht-Ninjas auseinanderhalten kann. Das könnt ihr auch.

Schritt 1: Kategorien festlegen

Ein Ninja-Detektor ist nur so gut wie seine Kategorieauswahl. Denn ohne die Nicht-Ninja-Kategorie würde der Detektor jedes Bild zwingend der Ninja oder Streamer-Kategorie zuordnen – er kennt keine anderen. Das würde den Ninja-Detektor nutzlos machen.

Schritt 2: Daten sammeln

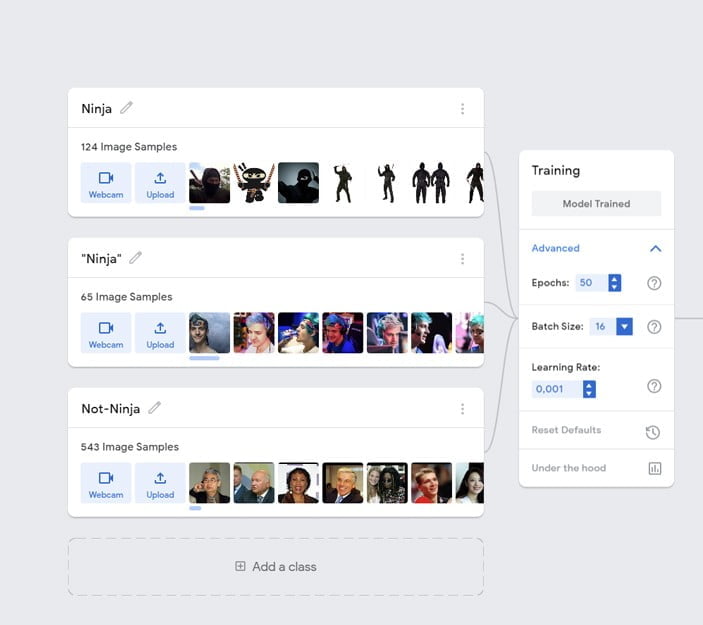

Die Bildanalyse-KI im Hintergrund von Teachable Machine ist MobileNet, ein mit dem ImageNet-Datensatz vortrainiertes KI-Modell. Mit meinen Kategorien trainiere ich die KI also nur um und nicht grundlegend neu. Daher reichen schon 25 bis 50 Fotos für einen zuverlässigen Ninja-Detektor.

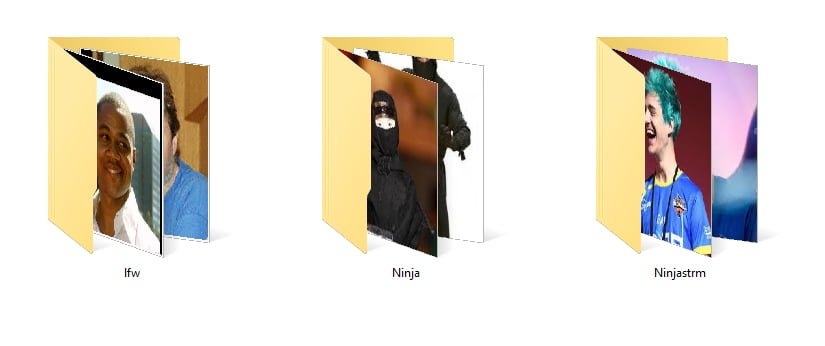

Meine Kategorien bestimmen, welche Daten ich sammeln muss. Für meinen Ninja-Detektor benötige ich Bilder von echten Ninjas, dem bekannten Spiele-Streamer Ninja und Fotos von Menschen, die keiner der beiden Kategorien angehören.

Für die beiden Ninja-Kategorien nutze ich Googles Bildersuche und ein Chrome-Addon, mit dem ich mehrere Bilder auf einmal herunterladen kann. Für die Nicht-Ninjas verwende ich Teile des Gesichtsdatensatzes Labeled Faces in the Wild der Universität Massachusetts.

Alternativ könnt ihr Objekte der Kategorien vor eure Webcam halten und Google macht automatisch Fotos. Alle Daten werden lokal gespeichert.

Schritt 3: KI-Training

Wenn die Kategorien feststehen und alle Trainingsdaten hochgeladen sind, muss die KI trainieren. Das Training startet ihr mit einem Klick. Fortgeschrittene Einstellungen sind verfügbar, aber auch mit den Standardeinstellungen erzielt ihr gute Ergebnisse.

Das Training läuft lokal im Browser, der Tab muss während des Trainings daher offenbleiben. Da Teachable Machine das MobileNet per Transferlernen (Definition) trainiert, ist der Prozess schnell abgeschlossen.

Schritt 4: Test

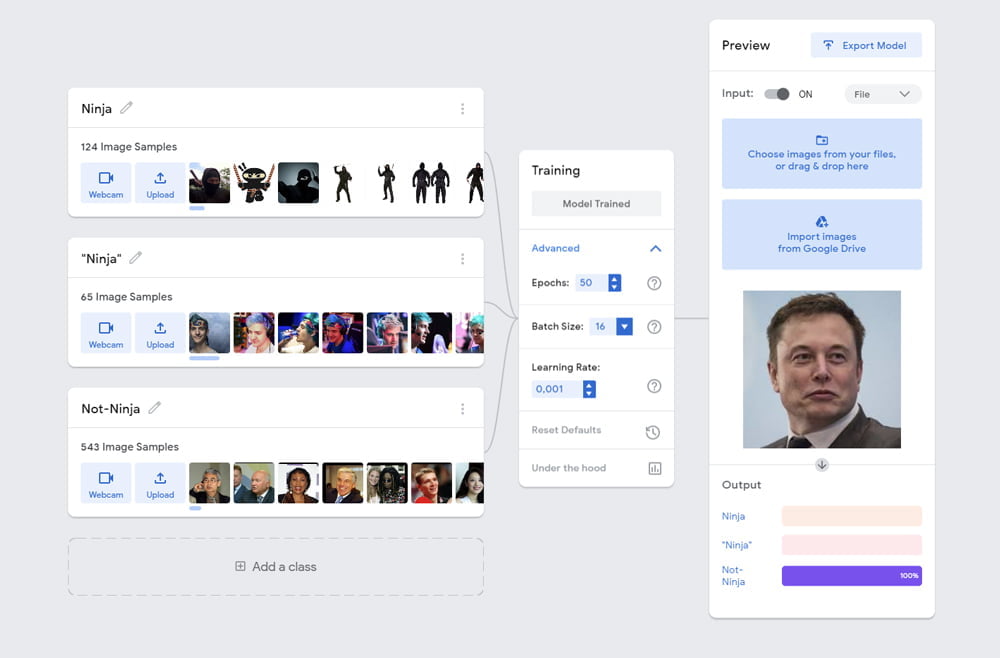

Nach dem Training kann das KI-Modell per Webcam oder lokal vorhandenem Bild getestet werden.

Mein Ninja-Detektor schlägt sich überraschend gut und erkennt sogar den Fortnite-Skin des Spiele-Streamers Ninja mit maximaler Sicherheit als Person Ninja - obwohl der Skin nur eine digitale Interpretation der realen Person ist.

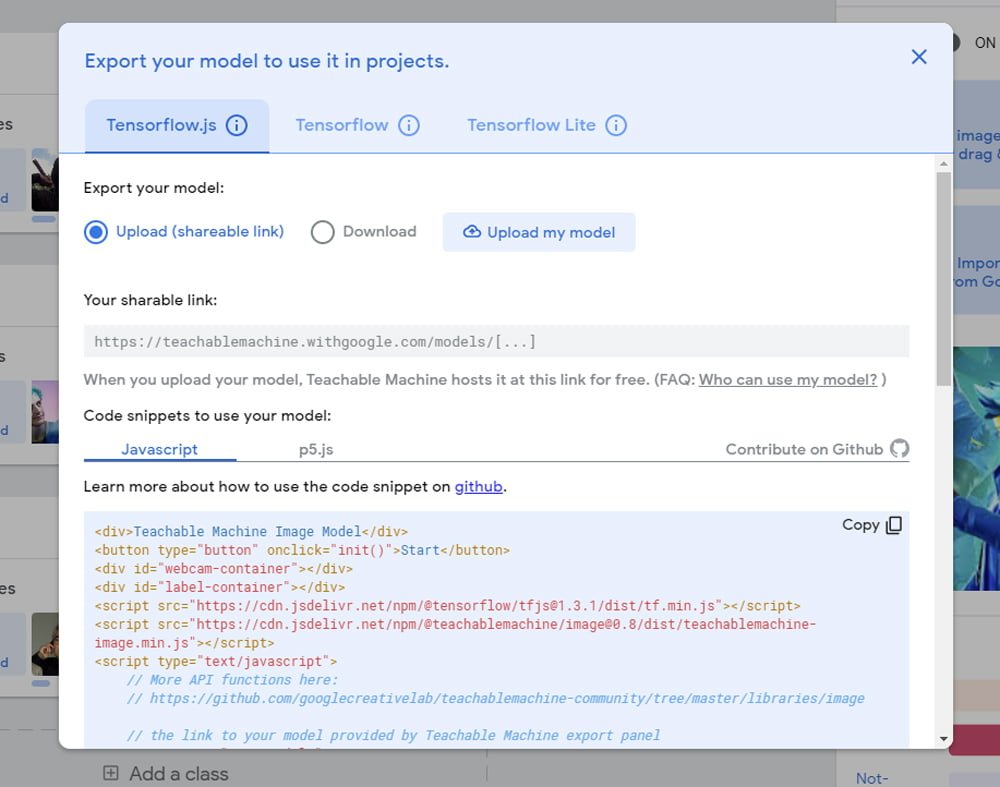

Schritt 5: Fertiges Modell exportieren

Mit Klick auf "Export Model" könnt ihr euer KI-Modell speichern. Wer es für weitere Projekte nutzen will, kann es für Tensorflow.js, Tensorflow oder Tensorflow Lite für Mobile- und Edge-Geräte exportieren.

Alternativ könnt ihr das Modell lokal oder in der Cloud speichern. Mit der letztgenannten Variante erhaltet ihr einen Link, über den ihr euer Modell jederzeit online im Browser nutzen könnt. Meinen Ninja-Detektor könnt ihr im Browser via Teachable Machine testen.

Fazit: KI-Training geht einfach und schnell

Techable Machines zeigt, wie schnell heute jeder einfache KI-Anwendungen zusammenklicken kann. Ohne Programmierkenntnisse sorgt das zwar nur für kurzweiligen Spaß, doch mit Code-Kenntnissen könnt ihr so schnell einfache KI-getriebene Apps bauen.

So oder so: Teachable Machines bietet einen tollen Einstieg für alle, die mit KI-Detektoren experimentieren und die Fallstricke bei der Kategorisierung und beim KI-Training aus eigenen Experimenten lernen wollen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.