"Tree of Thoughts" verbessert GPT-4s logische Fähigkeiten

Das "Tree of Thoughts"-Framework kombiniert Entscheidungsbäume mit GPT-4 und verbessert so die Problemlösungsfähigkeiten des Sprachmodells dramatisch.

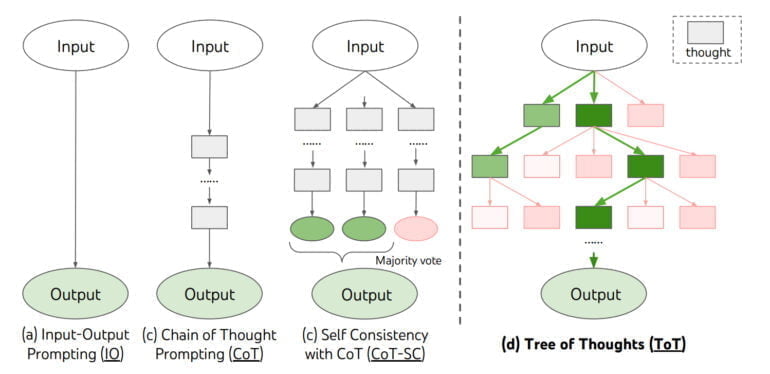

"Tree of Thoughts" ist ein neues Framework von Forschenden der Princeton University und Google DeepMind für die Inferenz von Sprachmodellen wie GPT-4, das von Prompt-Engineering-Methoden wie "Chain of Thought" inspiriert ist. Im Gegensatz zu diesen basiert ToT jedoch nicht nur auf Prompting, sondern verwendet ein externes Modul, um Textabschnitte, die das Team als "Gedanken" bezeichnet, als Zwischenschritte für die Problemlösung zu verwenden.

Dem Team zufolge ermöglicht ToT GPT-4, Entscheidungen zu treffen, indem verschiedene Argumentationspfade in Betracht gezogen werden und die eigenen Entscheidungen selbst bewertet werden, um die nächsten Handlungsschritte zu bestimmen. Zudem kann da System im Entscheidungsbaum vorwärts oder rückwärts gehen, wenn eine Entscheidung getroffen werden muss.

In Experimenten zeigt das Team, dass das ToT-Framework die Problemlösefähigkeiten von GPT-4 zum Teil dramatisch verbessert. Während GPT-4 beispielsweise in "Game of 24" mit Chain-of-Thought-Prompting nur 4 Prozent der Aufgaben lösen kann, erreicht das Sprachmodell mit ToT eine Erfolgsquote von 74 Prozent. Auch bei Mini-Kreuzworträtseln oder kreativen Schreibaufgaben verbessert die Methode die Ergebnisse von GPT-4 signifikant.

GPT-4 und AlphaZero finden zusammen

So kombiniert ToT die rudimentären Fähigkeiten großer Sprachmodelle wie GPT-4 zum logischen Schlussfolgern mit der Suche, wie sie in KI-Systemen wie AlphaZero verwendet wird. Anders als das KI-System von DeepMind lernt ToT keine Heuristiken, sondern verwendet GPT-4, um über die nächsten Schritte im Entscheidungsbaum nachzudenken. Nach Angaben des Teams ist ToT auch von Daniel Kahnemans Unterscheidung zwischen System 1 und System 2 inspiriert.

Tree of Thoughts bietet eine Möglichkeit, klassisches Problemlösungswissen in praktikable Methoden für moderne LMs zu übersetzen. Gleichzeitig beheben LMs eine Schwäche dieser klassischen Methoden, indem sie einen Weg bieten, komplexe Probleme zu lösen, die nicht leicht zu formalisieren sind, wie etwa kreatives Schreiben.

Yao et al.

In einem weiteren Preprint zeigt ein Forscher von Theta Labs ebenfalls eine "Tree-of-Thought"-Methode und signifikante Verbesserungen bei Sudoku-Puzzles. Der Autor nennt die von AlphaZero bekannten Self-Play-Techniken als interessante Forschungsrichtung. Eine ähnliche Methode könnte es dem ToT-System ermöglichen, neuartige Problemlösungsstrategien zu entwickeln, die im Trainingstextkorpus der Sprachmodelle nicht zu finden sind.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.