Derzeit werden Milliarden in die generative KI investiert, die wieder eingespielt werden wollen. Neue Berichte und Analysen zeigen, dass dies nicht so einfach ist.

Laut einer anonymen Quelle des Wall Street Journals hat Microsoft in den ersten Monaten des Jahres mehr als 20 US-Dollar pro Nutzer und Monat an die generative Code-KI Github Copilot verloren. Einige Nutzer sollen bis zu 80 Dollar pro Monat gekostet haben. Microsoft nimmt 10 Dollar pro Monat. Grund ist der teure Betrieb der KI-Modelle, die den Code generieren. Die Anwendung ist bei Entwicklern beliebt und hat derzeit rund 1,5 Millionen Nutzer.

Unternehmen wie Microsoft, Adobe, Google oder Zoom reagieren bereits auf die hohen Betriebskosten und bieten KI-basierte Upgrades ihrer Software zu höheren Preisen an. Adobe führt Nutzungslimits ein und rechnet nach Verbrauch ab. Zoom senkt die Kosten durch eine einfachere, selbst entwickelte KI.

"Wir versuchen, einen hohen Mehrwert zu bieten, aber wir müssen auch auf die Kosten achten", sagt Adobe-Chef Shantanu Narayen. AWE-Chef Adam Selipsky spricht von einer Unzufriedenheit der Kunden mit den hohen Betriebskosten von KI-Modellen.

Umsatzwachstum der ChatGPT-App angeblich rückläufig

Ein weiteres Problem sind die Knappheit und die Kosten der Chips. OpenAI kooperiert mit Microsoft und nutzt für seine Dienste einen Supercomputer mit 10.000 Nvidia-GPUs. Laut Bernstein-Analyst Stacy Rasgon kostet hier jede Anfrage etwa 4 Cent.

Würden diese Anfragen nur ein Zehntel des Volumens der Google-Suche erreichen, läge die Anfangsinvestition in GPUs laut Rasgon bei etwa 48,1 Milliarden Dollar, bei jährlichen Wartungskosten von etwa 16 Milliarden Dollar. Dieses Geld muss erst einmal verdient werden.

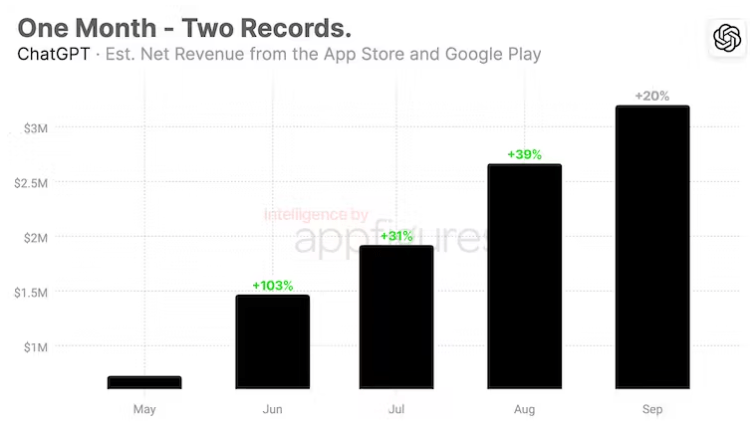

In diesem Sinne hat es für OpenAI auch eine positive Seite, wenn die Analyse-Plattform "Appfigures" schätzt, dass das Umsatzwachstum der ChatGPT-App von bis zu 39 Prozent im August auf 20 Prozent im September gefallen ist. Der Umsatz im September wird auf 4,58 Millionen Dollar geschätzt.

Laut Appfigures wurde die ChatGPT-App rund 52 Millionen Mal heruntergeladen, allein im September gab es 15,6 Millionen Neuinstallationen. 9 Millionen kamen über Android, 6,6 Millionen über iOS.

Die Verlangsamung des Umsatzwachstums könnte darauf hindeuten, dass die App vorerst die Grenze an Nutzern erreicht hat, die bereit sind, für das kostenpflichtige und im Betrieb deutlich teurere Modell GPT-4 im Vergleich zu GPT-3.5 zu zahlen. GPT-4 ist jedoch qualitativ deutlich überlegen.

Raus aus der KI-Kostenfalle: Eigene KI-Chips und effizientere Architekturen

Um aus der generativen KI mittelfristig ein Geschäftsmodell zu machen, versuchen die großen Technologiekonzerne bei KI-Chips unabhängiger von Nvidia zu werden, das derzeit die Preise diktiert. Amazon und Google produzieren bereits eigene Chips. Microsoft soll demnächst einen ersten KI-Chip vorstellen und auch OpenAI denkt über eigene Chips nach.

Die Unternehmen forschen auch an effizienteren KI-Architekturen. Kleinere KI-Modelle, die mit besonders hochwertigen Daten trainiert werden, können zumindest in ausgewählten Anwendungsszenarien die Qualität größerer Modelle erreichen. Das zeigt etwa das Modell Phi, mit dem Microsoft experimentiert.

Microsoft-Forschungschef Peter Lee habe "viele" der insgesamt 1500 Forscherinnen und Forscher bei Microsoft damit beauftragt, Dialog-KI-Systeme wie Phi zu entwickeln, die kleiner und billiger zu betreiben seien, berichtete kürzlich The Information.

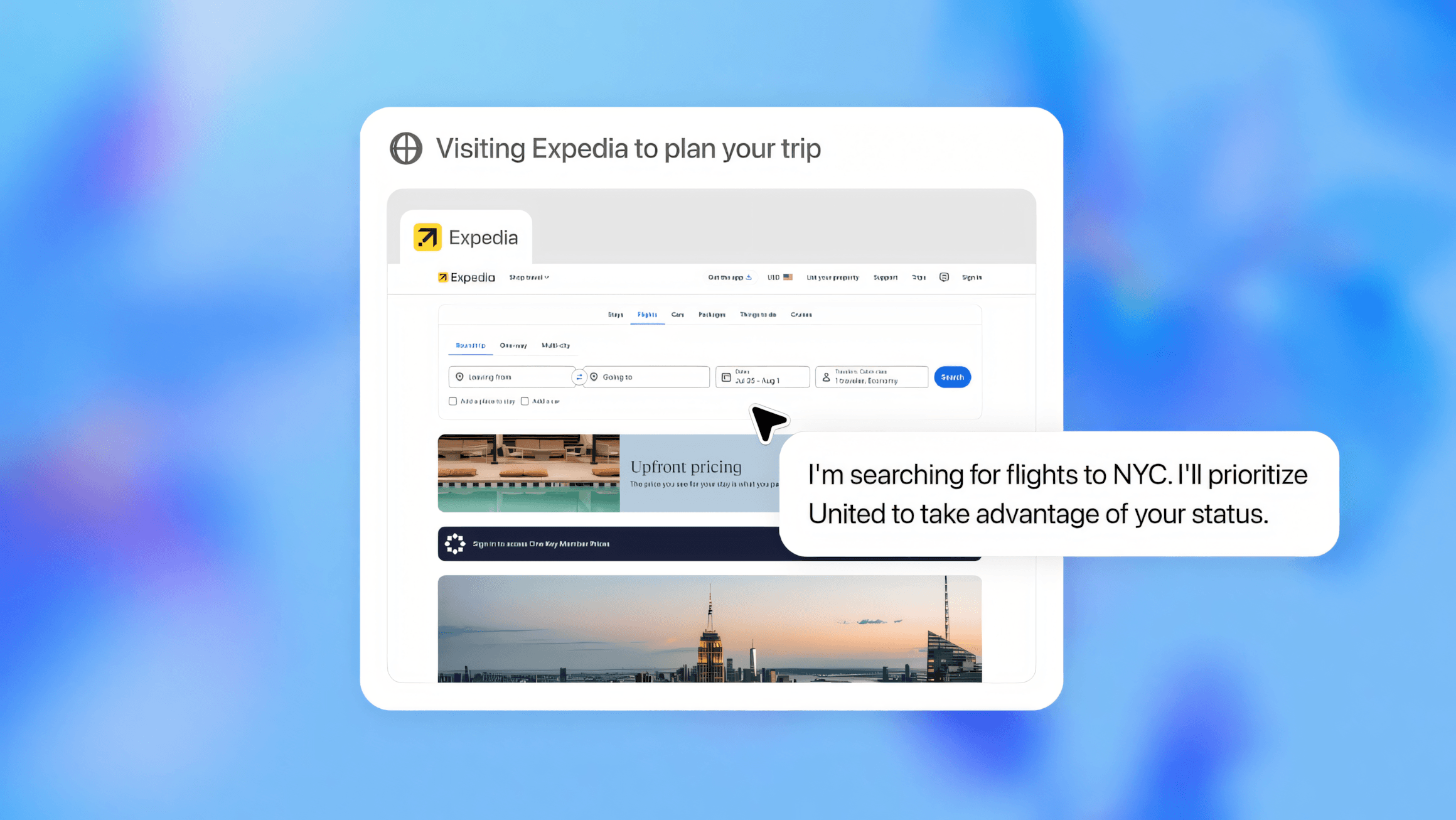

Die Umstrukturierung bei Microsoft stehe erst am Anfang, heißt es. Und sie birgt neue Risiken: GPT-4 ist für viele Aufgaben gerade gut genug, für andere, wie das Internet-Browsing, ist das Modell bisher nicht konkurrenzfähig.

Wann ist generative KI gut genug?

Wenn Hersteller jetzt wegen der hohen Kosten zu stark auf die Qualität drücken, könnten Nutzer:innen den Einsatz von generativer KI zurückfahren. Bleibt das Wachstum aus, sinken auch die Investitionen - eine Abwärtsbewegung des Marktes könnte die Folge sein.

Ein negatives Beispiel für Kostensparexperimente ist der "Balanced"-Modus im Bing-Chat, der neben GPT-4 auch günstigere Sprachmodelle von Microsoft verwendet. Das führt zu einer höheren Fehlerrate bei der Ausgabe, was etwa im Zusammenhang mit Wahlen besonders kritisch ist, wie AlgorithmWatch in einer aktuellen Untersuchung zeigt.

Die hohen Betriebskosten einer KI-Suche dürften auch der Grund dafür sein, dass Google derzeit an einer abgespeckten Version der eigenen KI-Suche "SGE" arbeitet. Sie könnte einen sanfteren Übergang zwischen den beiden Geschäftsmodellen ermöglichen, indem sie zunächst die hohen Betriebskosten eindämmt und dabei dem klassischen Werbegeschäft von Google die gewohnte Sichtbarkeit lässt.