Facebook veröffentlicht einen großen 3D-Datensatz, der helfen soll, Videos in 3D-Erfahrungen zu verwandeln. Das bietet sich etwa für VR- und AR-Geräte an.

Die Rekonstruktion von 3D-Objekten aus Fotos und Videos durch Künstliche Intelligenz hat großes Potenzial für die Digitalindustrie, etwa für AR- und VR-Anwendungen oder die schnelle Produktion von 3D-Modellen für Spiele und Filme.

Doch das Potenzial der Technologie ist weitaus größer: Wenn aus einfachen Videos fotorealistische 3D-Rekonstruktionen auf Smartphones oder für AR- und VR-Brillen werden, hätten Menschen eine völlig neue Möglichkeit, Erfahrungen und Erinnerungen zu speichern und weiterzugeben.

3D-Erinnerungen wären eine Killer-App für Facebook XR

Das ist eines der großen Ziele, die Facebook-Chef Mark Zuckerberg mit seinen XR-Investitionen verfolgt. „Eines Tages können wir ganze Erfahrungen einfangen und mit anderen Menschen teilen“, sagte Zuckerberg in der Vergangenheit.

Wenn es nach Facebook geht, sollen Nutzer:innen in Zukunft also Erfahrungen fotorealistisch und in 3D auf den Plattformen des Konzerns teilen. Entsprechend groß ist das Interesse von Facebook an 3D-Rekonstruktionsmethoden. Das Unternehmen betreibt Social-Plattformen wie Instagram, verkauft VR-Brillen und zukünftig auch eine Brille für Augmented Reality.

Um die Erforschung von 3D-Rekonstruktionsmethoden voranzutreiben, veröffentlicht Facebook jetzt einen Datensatz mit tausenden Videos und dutzenden Objekt-Kategorien.

Facebook CO3D bietet viele 3D-Daten für das KI-Training

Laut Facebook benötigen aktuelle Methoden der 3D-Rekonstruktion Datensätze, die Videos von realen Objekten und ihre genauen 3D-Nachbildungen zeigen, etwa ein Video von einem Apfel und sein 3D-Modell.

Große Fortschritte bei KI-Rekonstruktionsmethoden bleiben laut der Forscher:innen aus, da es keine umfassenden Datensätze gibt, die Videos von zehntausenden realen Objekten und ihre genauen 3D-Nachbildungen umfassen.

In einigen Fällen würden Forschende daher auf Datensätze digitaler 3D-Modelle zurückgreifen. Doch diese synthetischen Daten seien kein Ersatz für die Herausforderungen, die reale Aufnahmen an die KI-Algorithmen stellen, schreiben die Forschenden.

Video: Facebook AI

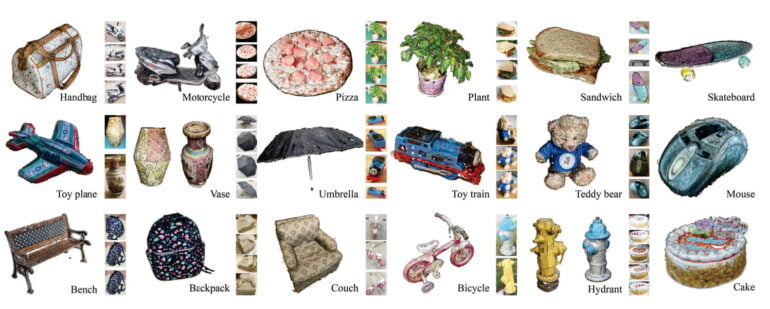

Facebooks "Common Objects in 3D"-Datensatz (CO3D) soll diese Lücke füllen: Der riesige Datensatz enthält 19.000 reale Videos in 50 Objekt-Kategorien des häufig eingesetzten MS-COCO-Bilddatensatzes, darunter Vasen, Handtaschen, Skateboards, Teddybären, Toaster und ähnliche Alltagsgegenstände, von denen man in Social Media gerne Fotos oder Videos teilt.

Insgesamt kommt CO3D so auf 1,5 Millionen Bilder zehntausender Objekte aus verschiedenen Kamerawinkeln. Alle Aufnahmen stammen von Smartphone-Kameras, die Facebook über Amazons Mechanical Turk gesammelt hat. Für die 3D-Rekonstruktion der Aufnahmen nutzten die Facebook-Forschenden anschließend sehr genaue und rechenintensive Methoden wie Point Clouds.

Facebook experimentiert mit Transformern für 3D-Rekonstruktion

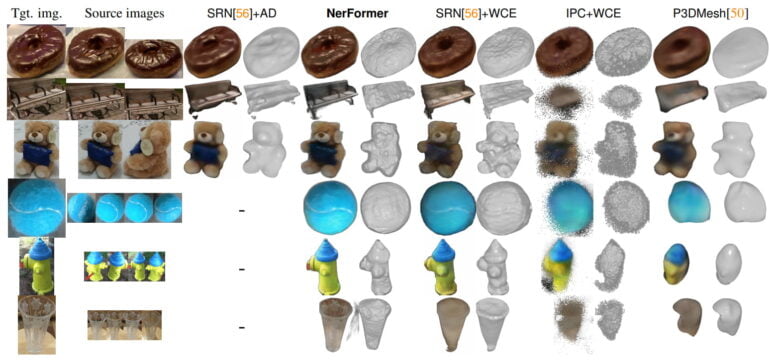

Mit der Veröffentlichung des CO3D-Datensatzes stellt Facebook auch NeRFormer vor, ein KI-Modell, das Videoaufnahmen in 3D-Rekonstruktionen verwandelt. NeRFormer lernt während des Trainings ein neuronales Strahlungsfeld (NeRF), das Geometrie und Oberfläche des Objektes repräsentiert.

Das Rendering wird dabei von einem Transformer-Modul ausgeführt, das die Eigenschaften des Strahlungsfeldes anhand der Videoinhalte vorhersagen und aus dem Strahlungsfeld neue Blickwinkel ableiten kann.

Laut Facebook kann NeRFormer durch diese Methode Gemeinsamkeiten bestimmter Objektkategorien lernen und neue Blickwinkel von bisher unbekannten Objekten mit nur einer kleinen Anzahl verfügbarer Ansichten rendern. Im Vergleich mit anderen Methoden soll NeRFormer 3D-Modelle schneller und mit höherer Qualität generieren.

Facebooks CO3D-Datensatz gibt es auf GitHub.