Normalerweise antwortet niemand, wenn man mit sich selbst spricht. KI kann diese Lücke füllen.

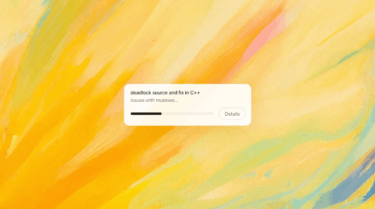

In einem Thread im Subreddit r/singularity hat ein Nutzer sein neuestes Projekt vorgestellt: ein großes Sprachmodell, das er mit 100 Stunden selbst geführter Interviews trainiert hat. Nun ist Nutzer UsedRow2531 in der Lage, Interviews mit einem "lokal laufenden Gespenst" seiner selbst zu führen.

Er erklärte, dass er das Projekt mit viel Tüftelei und "vielen späten Nächten, in denen er mit sich selbst sprach", realisiert habe. Er betonte, dass der Erfolg des Projekts weniger von der Methode als von der Qualität des Interviewkorpus abhänge.

Methode egal, Korpus entscheidend

Als Modell wählte er ggml-vic13b-q5_1 (Vicuna), nachdem er mit llama-2-70b-hf "seltsame Ergebnisse" erhalten hatte. Er war sich nicht sicher, ob dies auf seine fehlerhaften Modifikationen zurückzuführen war oder ob das Modell tatsächlich nicht das tat, was es tun sollte.

Praktischerweise kann sein Modell auch die Quelle angeben, sodass sich nachvollziehen lässt, aus welchem Zeitraum die Antwort stammt.

Google, Herumtüfteln und viele lange Nächte, in denen ich wie ein Verrückter mit mir selbst redete. Die Methode spielt keine Rolle. Es kommt auf die Qualität des Interviewkorpus an.

Bei einem riesigen Datensatz ist das "Wie" bedeutungslos. Das Modell wurde mit meinen Daten bis 2019 trainiert. Ich muss es noch mit denen von 2019 bis 2023 füttern. Es ist ein reiner POC [Anm. d. Red.: proof of concept], um mir zu beweisen, dass ich auf dem richtigen Weg bin.

u/UsedRow2531 auf Reddit

In der Reddit-Community stieß der Beitrag auf positive Resonanz. Viele Nutzer zeigten sich beeindruckt und fragten nach konkreten Anleitungen, um ebenfalls einen digitalen Zwilling von sich zu erstellen. Andere fragten nach möglichen Anwendungen für ähnliche Projekte, einschließlich der Möglichkeit, ein KI-Modell auf persönliche E-Mails zu trainieren.

Neue Werkzeuge auch für Historiker und Ermittler?

Die Diskussionen rund um den Beitrag von UsedRow2531 führten auch zu philosophischen Überlegungen über die Zukunft von Autobiografien und persönlichen Aufzeichnungen.

Der Benutzer u/Pelumo_64 stellte eine interessante Spekulation an. Er stellte sich vor, dass eine Person ihre Gedanken in einem digitalen Tagebuch festhält, bei Bedarf mit aus Audioaufnahmen generiertem Text. Dieser Text werde dann in einen interaktiven Bot umgewandelt, der Fragen beantworten könne.

Die Fragen könnten sich auf das tägliche Leben oder auf Überzeugungen beziehen, die die Person einmal hatte. Laut u/Pelumo_64 könnte so ein Bot ein wertvolles Werkzeug für Anthropolog:innen, Historiker:innen und Kriminalermittler:innen sein, um tiefer in die Gedanken und den Alltag von Menschen einzutauchen.

Auch das "Gespenst" halluziniert

Das Projekt reproduziert allerdings die bekannten Unzulänglichkeiten der großen Sprachmodelle. Diese mögen im privaten Umfeld zunächst belächelt werden, zeigen aber auch, dass der Beruf des professionellen Biografen wohl nicht so schnell aussterben wird.

Trotz der sorgfältig kuratierten Datenbasis zeigte das KI-Modell einige unerwartete Eigenschaften. Unter anderem wiederholte es mehrmals, dass es ein Genie sei oder an die Existenz von Außerirdischen glaube. Dies waren Aspekte, die u/UsedRow2531 in seinen ursprünglichen Interviews nie erwähnt hatte.

Das habe ich nie gesagt. Ich habe alles überprüft. Es wird aus der Form gebracht, wenn ich es korrigiere. Das LLM sieht sich an, was ich gesagt habe, und hält sich für ein Genie. Weder ist es ein Genie noch bin ich ein Genie. Alles sehr seltsam.

u/UsedRow2531 auf Reddit

Benutzer u/More_Grocery-1858 hat eine plausible Antwort: Das Modell arbeitet mit statistischen Wahrscheinlichkeiten und kennt daher die verschiedenen Verbindungen zwischen den Wörtern.

Menschen, die ähnliche Dinge sagten wie der Originalposter, würden sich demnach auch als Genies bezeichnen. Dies führe zu dem gezeigten Effekt, auch wenn der Threadstarter sich selbst kein Genie nenne.

Das Konzept ist tatsächlich nicht ganz neu: Schon Ende 2022 kam eine Künstlerin auf die Idee, GPT-3 mit Tagebucheinträgen aus ihrer Kindheit zu füttern, um sich so besser kennenzulernen. Was sagt der Erfinder u/UsedRow2531 selbst zu seinem Projekt? "Die Zukunft wird seltsam sein."