Künstliche Intelligenz: Googles Telefon-KI muss sich zu erkennen geben

Googles Künstliche Intelligenz Duplex telefoniert im Auftrag ihres Besitzers und täuscht die angerufene Person mit einer erstaunlich realistischen Fake-Stimme. Das führt zu einem Ethikproblem: Darf eine KI einen Menschen täuschen?

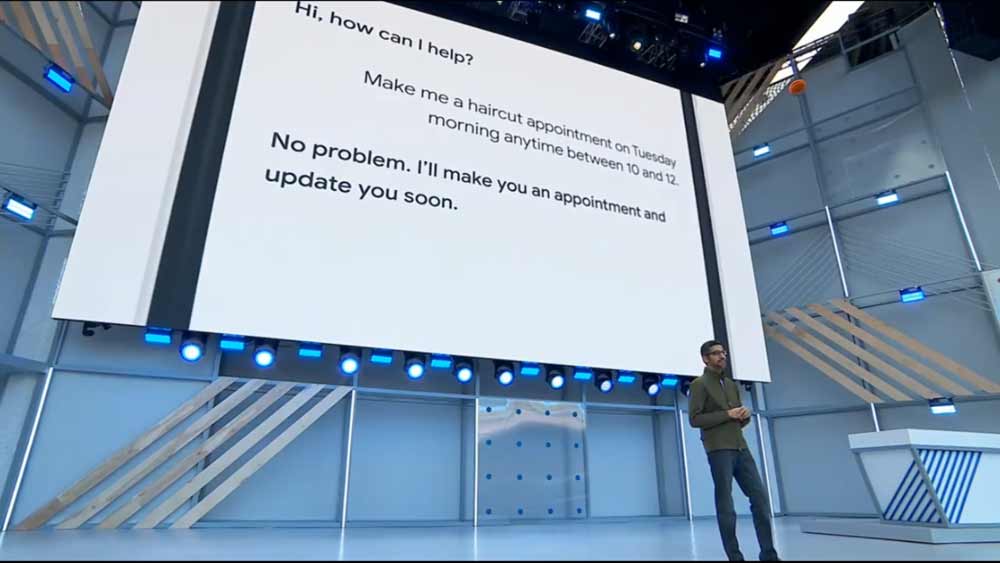

Es war die aufsehenerregendste Demonstration bei Googles Eröffnungsshow auf der Entwicklermesse I/O 2018: Eine Künstliche Intelligenz vereinbart telefonisch einen Friseurtermin und reserviert einen Tisch im Restaurant. Solche lästigen Telefonate soll Googles Duplex-KI zukünftig für viele Menschen übernehmen. Die Motivation für Nutzer: Bequemlichkeit.

Dass eine KI telefoniert, ist noch kein Aufreger. Wie sie es tut, das macht Duplex zum Thema: Denn sie klingt im Dialog so natürlich wie ein Mensch.

Sie streut Denk- und Sprechpausen ein, murmelt zwischendurch ein bestätigendes "Mhm" und reagiert souverän auf Rückfragen. Die Person am anderen Ende der Leitung hat keine Chance, die Computerstimme als solche zu entlarven.

Künstliche Intelligenz täuscht Menschen

Das macht den KI-Anruf zu einer bewussten Täuschung mittels Künstlicher Intelligenz. Google hat die KI-Stimme ganz offensichtlich dafür optimiert, Menschen im Unklaren über ihre Herkunft zu lassen - und ist damit erfolgreich. Zugegeben, in keinem besonders harten Fall. Aber wo zieht man die Grenze - und ab wann?

Hinzu kommt, dass Google viele unterschiedliche Sprachsynthesen verspricht. Nutzer könnten sich zukünftig die Stimme einer prominenten Person leihen. Oder sie lassen den Arbeitskollegen beim Chef anrufen, um die eigene Beförderung zu beschleunigen.

Erst kürzlich demonstrierten KI-Forscher, dass ein neuronales Netz schon anhand weniger Sprachfetzen den Klang einer Stimme imitieren kann. In Kombination mit einem mächtigen Dialogsystem wie Google es auf der I/O andeutete, wären KI-Manipulation und -Betrug im großen Stil möglich.

Man stelle sich vor, es gäbe solche Fake-Anrufe im Ausmaß von Spam-Mails. Nur mit dem Unterschied, dass die Information nicht von einem kryptischen Absender, sondern einer vertrauten Stimme übermittelt wird. Im Grunde müsste man gar nicht mehr abheben, wenn es klingelt.

Google verspricht Transparenz

Nun wäre es wünschenswert, dass diese Dystopie gar nicht erst eintritt. Möglich ist das vielleicht, wenn die Transparenz von Anfang an im Code integriert wird - und sich eine KI als solche zu erkennen gibt, wann immer sie mit einem Menschen in Kontakt tritt.

Die Forderung nach dieser Transparenz wurde in den Medien und sozialen Netzen laut, unmittelbar nachdem Google-Chef Sundar Pichai Duplex der Welt vorstellte.

Die türkische Schriftstellerin und auf Technologie spezialisierte Sozialforscherin Zeynep Tufekci fand bei Twitter besonders deutliche Worte: Das Silicon Valley sei "ethisch verloren, führerlos und habe nichts gelernt". Sie kritisiert das Publikum vor Ort, das bei der Duplex-Demonstration applaudierte, anstatt schockiert zu sein.

Die Reaktion von Google auf die zahlreichen Kritiker erfolgt schnell: Eine Sprecherin des Unternehmens teilt mit (via Cnet), dass Google den kritischen Diskurs wertschätze und Transparenz wichtig sei. Eine Ausweispflicht für die Telefon-KI solle fest ins System integriert werden. Die Show-Anrufe auf der I/O seien eine frühe Demonstration gewesen und die Rückmeldungen würden bei der Fortentwicklung berücksichtigt.

Auf der I/O-Bühne erwähnte Pichai die Transparenzfrage allerdings mit keiner Silbe - obwohl Alphabet im Herbst 2017 eigens eine Ethik-Abteilung für KI gründete. Die hat offenbar geschlafen, oder schlimmer: Sie hat kein Problem gesehen.

Offen ist, ob es am Ende wirklich Google sein wird, das im Alleingang über die Verwendung und die Transparenz solcher KI-Technologien entscheidet. Sehr wahrscheinlich ist das nicht: Duplex basiert auf Googles frei verfügbarer KI-Bibliothek Tensorflow. Mit dieser Software entwickelte auch der Pornofälscher Deepfakes seinen Algorithmus.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.