Microsoft Teams: KI beseitigt Nervfaktor bei Videokonferenzen

Microsoft will bei Teams-Videokonferenzen einen riesigen Nervfaktor mit KI killen: plötzlich auftretende Nebengeräusche.

Ziemlich viele Menschen haben in den letzten Wochen die Vor- und Nachteile von Videokonferenzen intensiv aus erster Hand erfahren.

Und wahrscheinlich haben 99 Prozent dieser Menschen auch die folgende Situation erlebt: Mitten in ein produktives Gespräch bellt der Hund, schreit das Baby oder knallt die Tür.

Verlegenes Grinsen, kurze Wartepause - alles still? "OK, wo waren wir gleich ..."

Solche unproduktiven Zwangspausen will Microsoft bei Teams zukünftig mit Künstlicher Intelligenz verhindern. Störende statische Hintergrundgeräusche wie einen brummenden Laptop-Lüfter kann Microsofts Software schon filtern, indem sie in Sprechpausen den Lärmpegel analysiert und annimmt, dass er konstant ist.

Viel anspruchsvoller ist jedoch dynamischer Hintergrundlärm wie das zuvor erwähnte Hundegebell. Wer weiß schon, wann Wuffi eine Fliege auf der Nase juckt?

Außerdem überlagern sich in solchen Situationen Hintergrundlärm und die Sprecherstimme - und es gibt eine lange Liste potenzieller Störgeräusche.

Innovation durch Datentraining

Microsoft will diese Audio-Probleme mit KI lösen: Ein neuronales Netz wird mit einem großen Datensatz an Störgeräuschen trainiert. Die KI analysiert die Klangdaten visuell in Form von Spektrogrammen.

"Maschinelles Lernen ermöglicht es uns, diese großen Datensätze für das KI-Training zu erstellen mit vielen repräsentativen Lärmquellen", sagt Microsoft-Teams-Manager Robert Aichner.

Mehr als 100 Störgeräusche lernte die KI während ihres Trainings kennen. Bestimmte Geräusche wie Instrumente oder Gesang sind aus ethischen Gründen nicht im Datensatz enthalten.

Gleichzeitig wird das neuronale Netz mit den Stimmen von tausenden Sprechern trainiert. Dann mixt Microsoft die saubere Sprachausgabe mit den Lärmquellen und simuliert so eine nervige Videokonferenz für die KI-Hausaufgabe.

KI trennt Stimme und Lärm

In einem überwachten Lernprozess (Erklärung) lernt die KI, das Sprachsignal in Echtzeit wieder von den Störgeräuschen zu trennen und nur die saubere Sprecherstimme zu übertragen.

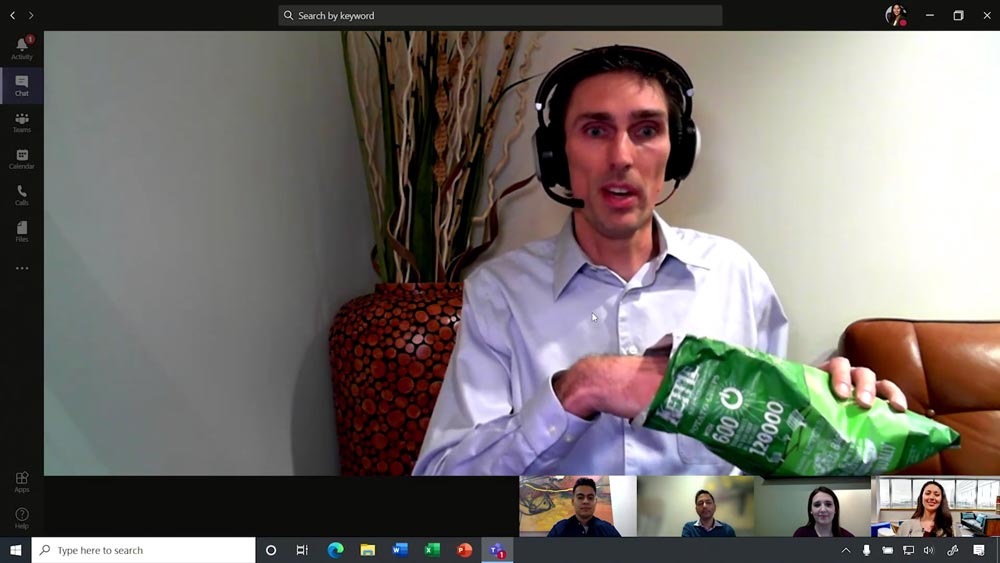

Da das neuronale Netz mit vielen unterschiedlichen Sprecherstimmen trainiert wurde, soll es die menschliche Stimme gut generalisieren können, also unabhängig des Klangs einer einzelnen Stimme verlässlich funktionieren. Das folgende Video zeigt die KI-Technik im Einsatz.

Microsoft rollt die Lärmkillerfunktion bald aus: Dafür wurde das Modell auf wenige Megabyte geschrumpft und wird lokal installiert - schließlich soll es auch auf dem Smartphone laufen.

Ein Teil der Berechnungen findet in der Edge Cloud statt: Für die KI-Echtzeitkorrektur des Audiosignals muss die Latenz so gering wie möglich sein. Reine Cloud-Berechnungen wären zu langsam.

Nach dem Rollout soll die Lärmunterdrückung laut Aichner weiter verbessert werden: "Der Teams-Client kann neue Modelle herunterladen und so die Qualität verbessern, wenn wir eine bessere Version am Start haben."

Quellen: Venturebeat, Microsoft

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.