Das OpenAI-Drama geht weiter: Greg Brockman beschreibt den Ablauf des Rauswurfs, den er nach eigenen Angaben immer noch zu rekonstruieren versucht. Die treibende Kraft hinter dem Rauswurf war vermutlich der OpenAI-Mitbegründer Ilya Sutskever, der für KI-Sicherheit zuständig ist.

Ausschlaggebend für die aktuelle Situation sei ein interner Streit über die Ausrichtung der KI-Sicherheit. Der am Rauswurf beteiligte OpenAI-Mitgründer Ilya Sutskever ist auch Leiter des Teams für die Ausrichtung der Superintelligenz.

Spekulationen ranken sich um eine von Altman zu stark forcierte Kommerzialisierung von KI, die zulasten der KI-Sicherheit gehen könnte. Das ursprüngliche Ziel von OpenAI als Forschungsorganisation, sichere generelle Künstliche Intelligenz (AGI) für die Menschheit zu entwickeln, würde der Kommerzialisierung entgegenstehen.

Hinzu kamen in jüngster Zeit Cybersicherheitsvorfälle, bei denen OpenAI angegriffen wurde, es immer wieder zu Ausfällen kam und der OpenAI-Partner Microsoft sogar kurzzeitig den Zugang zu ChatGPT für die eigenen Mitarbeiterinnen und Mitarbeiter sperrte.

Auch die neuen GPTs wurden unter Sicherheitsaspekten kritisiert. Einmal hochgeladene Dateien können von anderen Nutzern wieder heruntergeladen werden, ohne dass der Ersteller des GPT davon erfährt. Ein entsprechender Hinweis wurde einige Tage nach dem Start eingefügt. Befürworter der Sicherheitstheorie können in einem solchen Vorfall die Bestätigung sehen, dass überhastete Markteinführungen der Sicherheit schaden.

OpenAI-Führungswechsel könnte Verschiebung von Marktdominanz zu KI-Sicherheit bedeuten

Bei einer internen Mitarbeiterversammlung zum Rauswurf bestätigte Sutskever diese Gerüchte indirekt, berichtet The Information.

Der Rauswurf sei kein "Coup" und keine "feindliche Übernahme", sagte Sutskever. Der Vorstand habe seine Pflicht getan, um sicherzustellen, dass OpenAI eine sichere AGI zum Nutzen aller entwickle. Er räumte auch ein, dass die Art und Weise des Rauswurfs "nicht ideal" gewesen sei.

Sutskever ist überzeugt, dass das Ziel einer generellen Künstlichen Intelligenz (AGI) erreichbar ist und den Lauf der Menschheit verändern wird.

Anfang Oktober schrieb er auf Twitter.com: "Wenn du Intelligenz über alle anderen menschlichen Qualitäten stellst, wirst du eine schlechte Zeit haben."

Interims-CEO Mira Murati, die bereits viele Teams des Unternehmens in verschiedenen Rollen und als CTO geleitet hat, betonte in einem Memo an die Mitarbeitenden "unsere Mission und unsere Fähigkeit, gemeinsam sichere und nützliche AGI zu entwickeln."

Das strategische Ziel dieses Rauswurfs könnte sein, die Geschwindigkeit von OpenAI im kommerziellen Bereich zu verlangsamen. Altman hat sich zudem kürzlich skeptisch geäußert, dass die Entwicklung großer Sprachmodelle ausreicht, um AGI zu erreichen. Sutskever hat hier möglicherweise eine andere Perspektive und könnte befürchten, dass Altman das Potenzial von Modellen unterschätzt.

Brockman und Altman sind "traurig und schockiert"

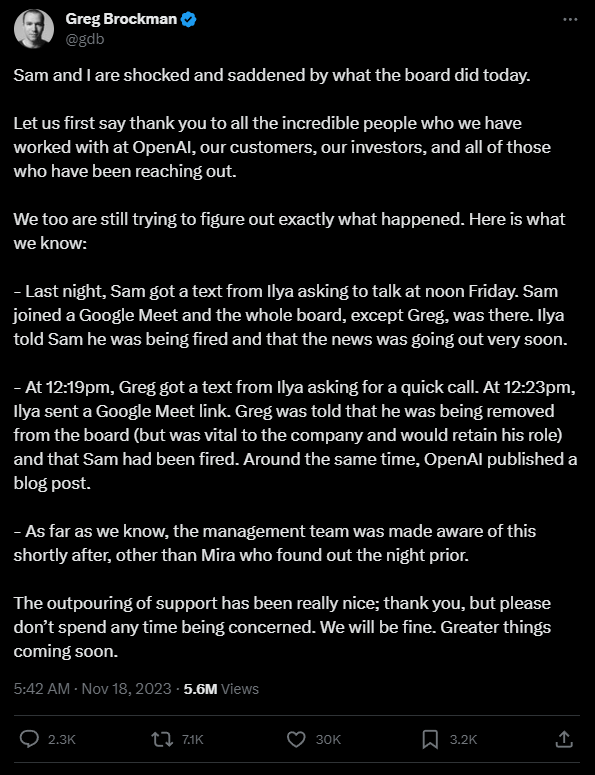

"Sam und ich sind schockiert und traurig über das, was der Vorstand heute getan hat", schreibt Brockman. Altman spricht von einer "in vielerlei Hinsicht bizarren Erfahrung".

Sam Altman sei in der Nacht von Donnerstag auf Freitag von OpenAI-Chefwissenschaftler und Vorstandsmitglied Ilya Sutskever zu einem Treffen am Freitagmittag eingeladen worden. Bei diesem Google-Meeting sei der Vorstand ohne Greg Brockman gewesen und habe Sam Altman mit dem Hinweis gefeuert, dass diese Nachricht bald veröffentlicht werden würde. Altman habe nicht an der Abstimmung teilgenommen.

Kurz darauf wurde Brockman in einem Google-Meeting mitgeteilt, dass Sam Altman entlassen und er aus dem Vorstand entfernt worden sei, er aber im Unternehmen bleiben könne, da er für das Unternehmen wichtig sei. Anschließend wurde das Managementteam informiert. Die neue Interims-CEO, Mira Murati, sei bereits in der Nacht zuvor informiert worden.

Kurz darauf verließ Brockman OpenAI auf eigenen Wunsch. Den nächsten Schritt stellt er bereits in Aussicht: "Bald kommt etwas Größeres."

OpenAI verliert weitere Forschende

Nach Altmans Rauswurf sollen auch Jakub Pachocki, Forschungsdirektor des Unternehmens, Aleksander Madry, Leiter eines Teams, das potenzielle Risiken von KI bewertet, und der langjährige Forscher Szymon Sidor OpenAi verlassen haben, berichtet The Information unter Berufung auf gut informierte Kreise.

Pachocki und Sidor waren an der Entwicklung von GPT-4 beteiligt, während Madry ein Team leitete, das sich mit der Risikobewertung von KI beschäftigte.

Auch Microsoft wurde nur kurz vor Altmans Rauswurf informiert

Auch prominente Investoren, darunter Vinod Khosla und Reid Hoffman, wurden von Altmans Entlassung überrascht. Vier Quellen, die direkt mit der Situation vertraut sind, sagten Forbes, dass wichtige Risikokapitalgeber von OpenAI nicht vorgewarnt wurden.

Microsoft, das mehr als zehn Milliarden Dollar in OpenAI investiert hat, erfuhr von Altmans Entlassung und seinem Ausscheiden aus dem Vorstand nur eine Minute, bevor die Nachricht im OpenAI-Blog veröffentlicht wurde, so ein Bericht von Axios.

Microsoft-CEO Satya Nadella äußert sich auf LinkedIn zu Altmans Rauswurf, erwähnt Altman in seinem Post aber nicht. Stattdessen betont er Microsofts Engagement für die Entwicklung von KI, wie auf der Ignite demonstriert, und hebt die geplante langfristige Zusammenarbeit mit OpenAI hervor.

"Wir haben eine langfristige Vereinbarung mit OpenAI mit vollem Zugang zu allem, was wir brauchen, um unsere Innovationsagenda und eine aufregende Produkt-Roadmap zu liefern; und wir bleiben unserer Partnerschaft und Mira und dem Team verpflichtet. Gemeinsam werden wir weiterhin die bedeutenden Vorteile dieser Technologie in die Welt bringen."

Satya Nadella, CEO Microsoft

Microsoft lieferte in den vergangenen Monaten immer wieder Beispiele für den unsicheren Rollout von KI, etwa das Nachrichtenportal MSN.com, das menschliche Redakteure mit KI ersetzt, die dann Fake News verbreiten.

Eine aktuelle Studie von AlgorithmWatch und AI Forensics in Zusammenarbeit mit den Schweizer Sendern SRF und RTS hat ergeben, dass Microsofts Bing Chat auf Fragen zu den bevorstehenden Wahlen in Deutschland und der Schweiz falsche Antworten gab.

Auch die zahlreichen Ausfälle des Bing Chatbots aka "Sydney" zu Beginn des überstürzten Rollouts Anfang des Jahres, um Google Suchmarktanteile abzujagen, dürften den Sicherheitsbefürwortern bei OpenAI ein Dorn im Auge gewesen sein. Angeblich warnte OpenAI Microsoft davor, den Bing Chatbot mit einem unveröffentlichten GPT-4 ohne weiteres Training vorzeitig einzusetzen.