OpenAI-Forscher sollen in einem Brief an den Vorstand des Unternehmens vor einer KI-Entdeckung gewarnt haben, die eine Bedrohung für die Menschheit darstellen könnte.

Das berichtet Reuters unter Berufung auf zwei mit der Angelegenheit vertraute Quellen. Der Brief stehe auch in Zusammenhang mit dem zwischenzeitlichen Rauswurf Altmans, sei aber nicht der einzige Grund.

Laut einer Quelle von The Verge hat der Vorstand nie einen solchen Brief erhalten, weshalb er auch keine Rolle bei der Entlassung Altmans gespielt habe. Reuters gibt an, den Brief nicht gesehen zu haben. The Information berichtet nicht über den Brief selbst, aber über den darin beschriebenen Durchbruch "Q*".

Q-Star kann einfache mathematische Aufgaben selbstständig lösen

In dem angeblichen Brief geht es um den Algorithmus Q* (ausgesprochen Q-Star), der in der Lage sein soll, einfache mathematische Probleme, die nicht Teil des Trainingsmaterials sind, auf Grundschulniveau selbstständig zu lösen. Der leitende Wissenschaftler von OpenAI, Ilya Sutskever, soll für die Entwicklung verantwortlich sein.

Einige OpenAI-Forscherinnen und -Forscher sehen in Q-Star einen Durchbruch auf dem Weg zur künstlichen allgemeinen Intelligenz (AGI), da es ein Hinweis darauf sein könnte, dass das KI-System logische Denkfähigkeiten entwickelt hat, die allgemeiner und menschenähnlicher sind.

In ihrem Brief an den Vorstand wiesen die Forscher laut Reuters auf die Möglichkeiten und potenziellen Gefahren von KI hin, ohne die Sicherheitsbedenken im Detail zu benennen. Unter anderem könne ein solches KI-System die Wissenschaft enorm beschleunigen. Sie äußerten auch Bedenken, ob OpenAI die notwendigen Sicherheitsvorkehrungen für ein solches KI-System getroffen habe.

Die Forscher bezogen sich auch auf die Arbeit eines "AI Scientist Teams", dessen Existenz laut Reuters von mehreren Quellen bestätigt wurde. Die Gruppe ist aus der Fusion der früheren Teams "Code Gen" und "Math Gen" hervorgegangen. Sie untersucht, wie bestehende KI-Modelle optimiert werden können, um ihre Denkfähigkeiten zu verbessern und schließlich wissenschaftliche Arbeit zu leisten.

Hinter Q-Star sollen die beiden Forscher Jakub Pachocki und Szymon Sidor stehen, die auf der Arbeit von Ilya Sutskever aufbauen. Eine Demo des Systems soll seit einigen Wochen bei OpenAI im Umlauf sein.

Pachocki und Sidor kündigten kurz nachdem Altman von Sutsekver angeblich wegen Sicherheitsbedenken gefeuert wurde. Sie kehrten jedoch mit Altman zurück. OpenAI-Mitbegründer Greg Brockman soll an der Integration von Q-Star in OpenAI-Produkte arbeiten.

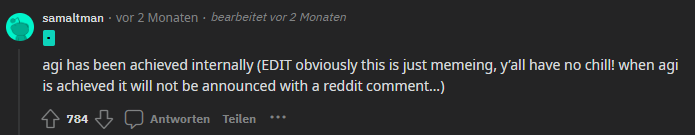

"AGI intern erreicht"

Möglicherweise bezog sich der OpenAI-Leaker "Jimmy Apples" auf Q-Star, als er Mitte September twitterte, dass "AGI intern erreicht wurde". OpenAI-Chef Sam Altman wiederholte diese Aussage sogar auf Reddit, korrigierte seine Nachricht aber später und fügte hinzu, dass "eine AGI natürlich nicht in einem Reddit-Kommentar angekündigt wurde" und er nur das Meme aufgegriffen habe.

Anfang November sagte Altman, dass aktuelle Sprachmodelle noch "einen weiteren Durchbruch" in Richtung einer AGI bräuchten. Dazu brauche es ein System, das neue physikalische Phänomene entdecken könne.

Kryptisch äußerte sich Altman dann auf dem APEC Summit 2023 am 16. November, kurz vor seinem Rauswurf. Er sei viermal in der Geschichte von OpenAI im Raum gewesen, als das Team "den Schleier der Unwissenheit gelüftet und die Grenzen der Entdeckung erweitert" habe. Das letzte Mal sei vor wenigen Wochen gewesen. Das könnte zeitlich mit "Jimmy Apples" AGI-Tweet zusammenfallen.

The Information berichtet zudem, dass Sutskever 2021 das Projekt GPT-Zero startete. Hier sollte ein Sprachmodell mehr Zeit und Rechenleistung für die Generierung einer Antwort auf neue akademische Entdeckungen erhalten. Genau diesen Codenamen "Zero" bringt nun auch der OpenAI-Leaker "Jimmy Apples" rund um die Gerüchte um den Brief wieder auf den Tisch.