Das CRM-Unternehmen Salesforce integriert zahlreiche KI-Dienste in seine eigenen Angebote. Das macht eine neue Richtlinie notwendig.

In der "Artificial Intelligence Acceptable Use Policy" stellt Salesforce klar, dass die eigenen KI-Systeme keine Verantwortung für Entscheidungen übernehmen können, die möglicherweise rechtliche oder ähnlich wichtige Auswirkungen haben.

Der Einsatz der KI-Produkte von Salesforce sei nur dann richtlinienkonform, wenn die endgültige Entscheidung von einem Menschen getroffen werde. Der Kunde muss neben der KI-Empfehlung auch andere Argumente berücksichtigen.

Generative KI darf qualifizierte Beratung nicht ersetzen

In eine ähnliche Richtung geht die Richtlinie, die festlegt, dass generative KI keine qualifizierte Beratung ersetzen darf, etwa in der Finanz- oder Rechtsberatung, und dass sie keine individuelle medizinische Beratung, Behandlung oder Diagnose generieren darf.

Ein unterstützender Einsatz von KI, etwa durch Zusammenfassungen längerer Texte, sei hingegen zulässig. Allerdings müsse auch in diesem Fall eine qualifizierte Fachkraft in den Prozess eingebunden sein, die die generierten Inhalte überprüft und freigibt.

Salesforce sichert sich auch gegen den Einsatz von KI für Diskriminierung, Missbrauch oder Täuschung sowie gegen den Einsatz der Systeme für politische Kampagnen und die Entwicklung von Waffen ab. Das gilt beispielsweise auch für die Vermarktung von Waffen.

Kunden verlangen Transparenz bei KI

Salesforce veröffentlicht auch die neueste Ausgabe der internationalen Studie "State of the connected customer". Hier zeigt sich das Misstrauen der Kunden, dass Unternehmen KI ethisch einsetzen - nur 57 Prozent gehen davon aus.

68 Prozent der Kunden sagen, dass Fortschritte in der KI Unternehmen vor die Herausforderung stellen, noch transparenter zu kommunizieren. 89 Prozent wollen beispielsweise wissen, ob sie im Kundensupport mit einem Menschen oder einer KI sprechen und 80 Prozent halten es für wichtig, dass KI-generierte Inhalte von Menschen geprüft und freigegeben werden.

Die Daten wurden in einer Doppelblindbefragung von 11.000 Verbrauchern und 3.300 gewerblichen Einkäufern vom 3. Mai bis 14. Juli 2023 in zahlreichen Ländern erhoben.

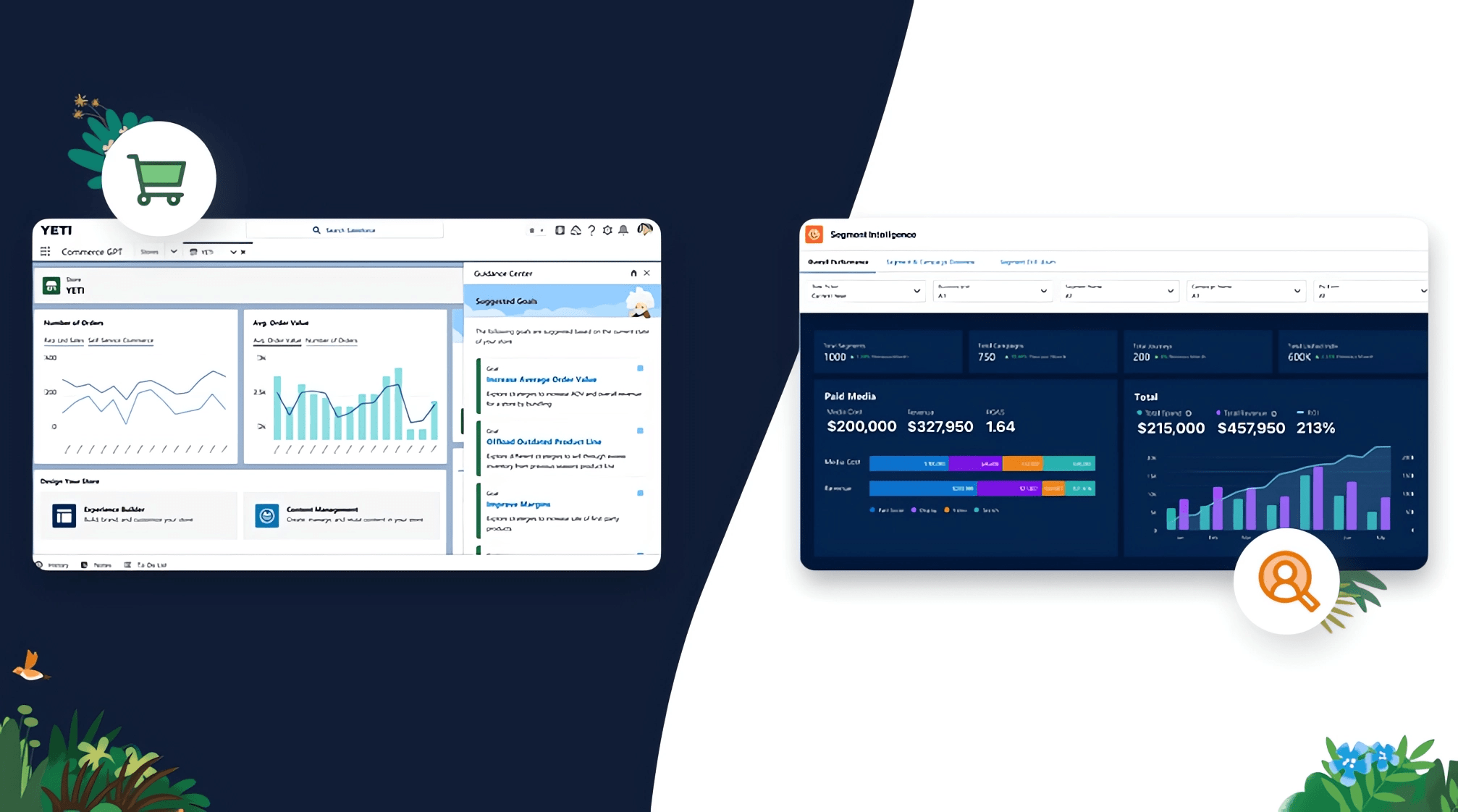

Salesforce bietet unter anderem spezialisierte Sprachmodelle für Marketing und Commerce sowie Service und Sales an, ist Investor beim auf B2B-KI spezialisierten Start-up Cohere und trainiert auch eigene KI-Modelle wie das Code-Modell T5.