- Ergebnisse der CCW ergänzt

Update vom 28. Dezember 2021:

Die von der Initiative "Stop Killer Robots" als "historisch" beschriebene Chance auf ein Verbot autonomer Waffen, die Menschen eigenständig lokalisieren, verfolgen, angreifen und töten können, ist verpasst. Der UN-Ausschuss fand keinen Konsens und konnte sich nur auf weitere Gespräche einigen - ohne klare Agenda für zukünftige Diskussionen. Für 2022 sind zehn weitere Gesprächstage geplant. Die Expertengruppe soll ihre Arbeit fortsetzen.

Zwar seien mehr als 60 Länder für die Verbannung entsprechender Waffen, aber der UN-Ausschuss entscheidet nach dem Konsensprinzip ohne Gegenstimmen. Mehrere Staaten, unter anderem die USA, Russland, UK, Indien und Israel, blockierten ein Verbot tödlicher autonomer Waffen.

Für ein Verbot setzten sich Neuseeland, Deutschland, Österreich, Norwegen, die Niederlande, Pakistan, China, Spanien und die 55 Länder der Afrikanischen Union ein. Insgesamt beteiligen sich 125 Vertragsstaaten der Konvention über bestimmte konventionelle Waffen (CCW) an der Diskussion.

"Das schleppende Tempo und das diplomatische Versagen in den Genfer Hallen stehen in krassem Gegensatz zu den rasanten Entwicklungen in der realen Welt, wo tödliche autonome Waffen gebaut und eingesetzt werden und sich immer schneller verbreiten", urteilt das Futur of Life-Institut. Die Schuld trügen einige wenige Staaten, die keine Einschränkungen bei Killerrobotern akzeptierten.

Die Hoffnung für 2022 läge nun auf Entscheidungsprozessen außerhalb der CCW, etwa im Rahmen der Generalversammlung der Vereinten Nationen oder als unabhängiger internationaler Vertrag außerhalb der UN-Prozesse, wie er in der Vergangenheit bei Regelungen für Landminen und Streumunition formuliert wurde.

Ursprünglicher Artikel vom 08. Dezember 2021:

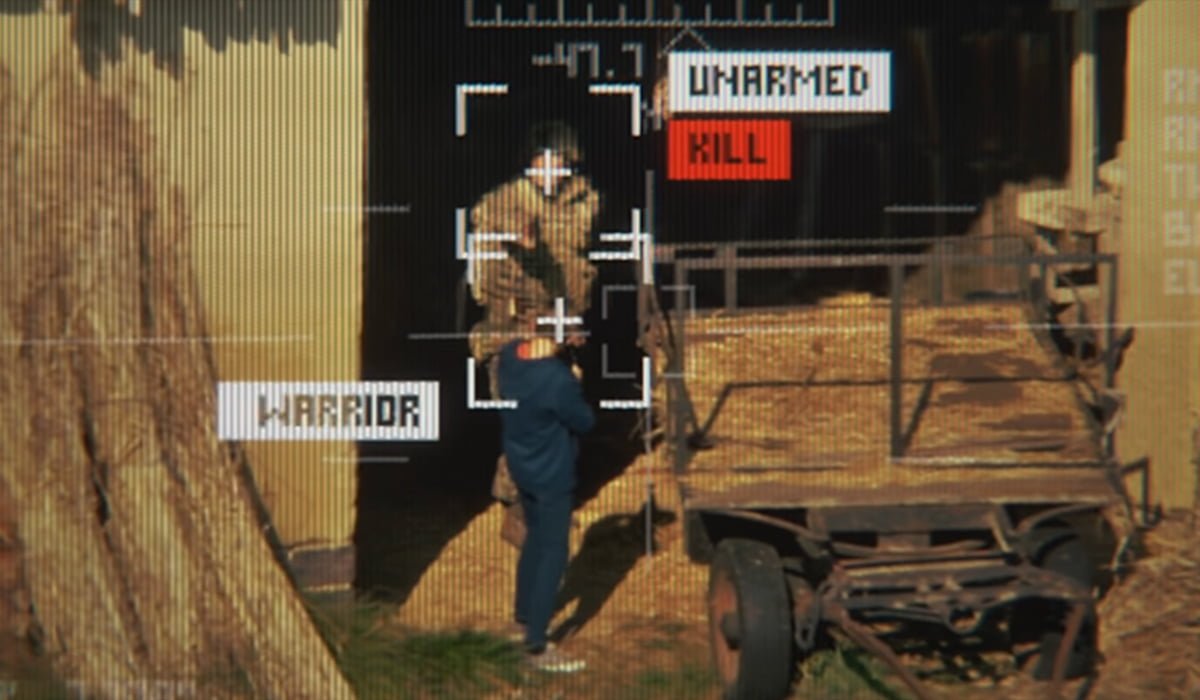

Tödliche autonome Waffen: Video warnt vor "Killerrobotern"

Darf Künstliche Intelligenz über Leben und Tod entscheiden? Das Future of Life-Institut macht in einem neuen Video auf die Risiken tödlicher autonomer Waffensysteme aufmerksam.

Derzeit findet in Genf die sechste UN Review-Konferenz über die „Konvention über bestimmte konventionelle Waffen“ statt, bei der über das weitere Vorgehen bei tödlichen autonomen Waffen entschieden wird. Die Arbeitsgruppe wird die Ergebnisse bisheriger Untersuchungen und Diskussionen präsentieren. Die Regierungssachverständigen sollen einen normativen und operativen Rahmen entwickeln.

Laut Amnesty International haben bislang 66 Länder einen neuen, rechtsverbindlichen Rahmen für autonome Waffensysteme gefordert. Einige mächtige Staaten wie die USA, Russland und Israel würden den Fortschritt jedoch bremsen, da sie "die Schaffung eines neuen internationalen Abkommens für verfrüht" hielten.

KI soll keine Tötungsentscheidung treffen

Der Kurzfilm "Slaughterbots - if human: kill()" soll im Vorfeld der Konferenz Einfluss auf alle Beteiligten ausüben. Produziert wurde der Film vom Future of Life-Institut (FLI), eine Gruppe von KI-Aktivist:innen rund um den MIT-Physiker und KI-Analysten Max Tegmark. Auch der Tech-Milliardär Elon Musk unterstützt das Institut finanziell.

Das Future of Life-Institut befasst sich mit den grundlegenden Bedrohungen der menschlichen Existenz, zu denen auch tödliche autonome Waffen gehören sollen, die das Institut als "Killerroboter" - Slaughterbots - bezeichnet.

Der neue Film warne "vor der zunehmenden Verbreitung" entsprechender KI-Systeme, die "Menschen ohne menschliches Zutun identifizieren, auswählen und töten" könnten. Das FLI unterstützt die Haltung des Internationalen Komitees vom Roten Kreuz (IKRK), das ein rechtsverbindliches internationales Verbot für autonome Waffen, die auf Menschen zielen, fordert.

Schon 2017 brachte das Future of Life-Institut einen ähnlich aufwendigen Warnfilm im Vorfeld politischer Debatten heraus. Dieser Film sei als unrealistisch und technisch unmöglich kritisiert worden. Seit der Veröffentlichung seien aber tödliche autonome Drohnen zum Einsatz gekommen, einfach zu entwickelnde Waffensysteme seien derzeit in Arbeit und ein globales Wettrüsten sei ohne regulatorische Vorgaben im Gange, so das FLI.

Da die Zahl der Anwendungsfälle im letzten Jahr rapide gestiegen sei, sei dies die letzte Chance der Arbeitsgruppe, die Empfehlung des IKRK für ein neues Gesetz gegen tödliche autonome Waffen umzusetzen.

Tödliche autonome Waffen: FLI fordert klare rote Linie

Dr. Emilia Javorsky vom Future of Life-Institut fordert "eine klare rote Linie", dass KI niemals beschließen dürfe, Menschen zu töten. Dies zum Schutz der Menschheit und um das Potenzial Künstlicher Intelligenz, die Welt zum Besseren zu verändern, abzurufen.

"Jetzt ist es an der Zeit, zu handeln und eine neue Wissenschaft, die KI, zu schützen. Um unserer Menschheit und unserer Zukunft mit KI willen müssen wir das richtig machen", sagt Javorsky.

"Das jüngste Auftauchen von Killerrobotern auf dem Schlachtfeld bedeutet, dass die Zeit abläuft, um zu verhindern, dass diese billigen Massenvernichtungswaffen in die Hände von jedem fallen, der sie haben will", sagt Tegmark.

"if human: kill()" sei eine Erinnerung daran, dass die Menschheit vor einer unmittelbaren Wahl stehe: "Schlachtroboter verbieten oder Jahrzehnte damit verbringen, zu bedauern, dass wir unsere Art zu Leben ruiniert haben", sagt Tegmark.

Laut des FLI unterzeichneten mehr als 250 Organisationen und rund 4000 führende KI- und Robotik-Forschende einen 2015 veröffentlichten offenen Brief, der vor den Gefahren tödlicher autonomer Waffensysteme warnt.

Unter ihnen ist der KI-Forscher Stuart Russell, der erst kürzlich vor einem KI-Wettrüsten warnte: Ein kleines bisschen Furcht vor KI sei in diesem Kontext angemessen.

„Ich denke, wenn eine Allzweck-KI im aktuellen Kontext der Rivalität der Supermächte geschaffen wird – sie wissen schon, wer die KI beherrscht, beherrscht die Welt, diese Art von Mentalität – dann denke ich, die Ergebnisse könnten die schlimmstmöglichen sein“, sagt Russell.