Deepfakes: Facebook stellt neue Tracking-Technologie vor

Facebook stellt eine neue Tracking-Methode für Deepfakes vor, die das generative KI-Modell hinter dem Fake identifizieren soll.

Als Betreiber der weltweit größten Social-Media-Plattformen hat Facebook ein ureigenes Interesse daran, Deepfakes zu erkennen und damit ihre Verbreitung bei Instagram und Co. zu regulieren. Die große Deepfake-Schwemme blieb zwar bislang aus, aber die Anzahl an Deepfakes im Netz nahm schon bis Ende 2019 deutlich zu und die Technologie wird kontinuierlich besser und zugänglicher.

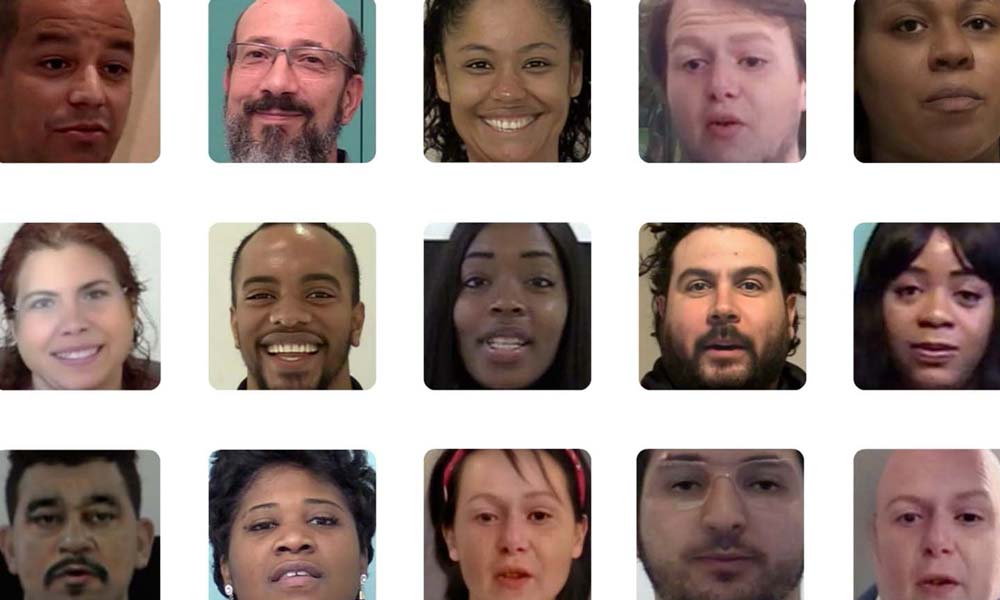

In der Vergangenheit rief Facebook daher eine Anti-Deepfake-Forschungsinitiative ins Leben und veröffentlichte unter anderem einen umfangreichen Datensatz, an dem Forscher ihre Erkennungsmethoden testen können.

Anfang Januar 2020 verbot Facebook Deepfakes auf den eigenen Plattformen, sofern diese Videos explizit mit KI oder maschinellem Lernen erstellt und nicht satirisch oder parodistisch sind. Damit gewährte Facebook Deepfakes eine Sonderstellung im eigenen Umgang mit Fake-Inhalten.

Deepfake-Modelle: Wie Kameras für Fotos

Jetzt stellt Facebook eine neue Erkennungsmethode vor, die Deepfakes anhand des Modells erkennen können soll, mit dem sie generiert wurden. Facebook-Forscher Tal Hassner vergleicht die Methode mit einem Vorgehen bei der Bildidentifikation, bei der Forensiker den Ursprung eines Bildes anhand der Eigenarten der Kamera, mit der das Bild geschossen wurde, erkennen können.

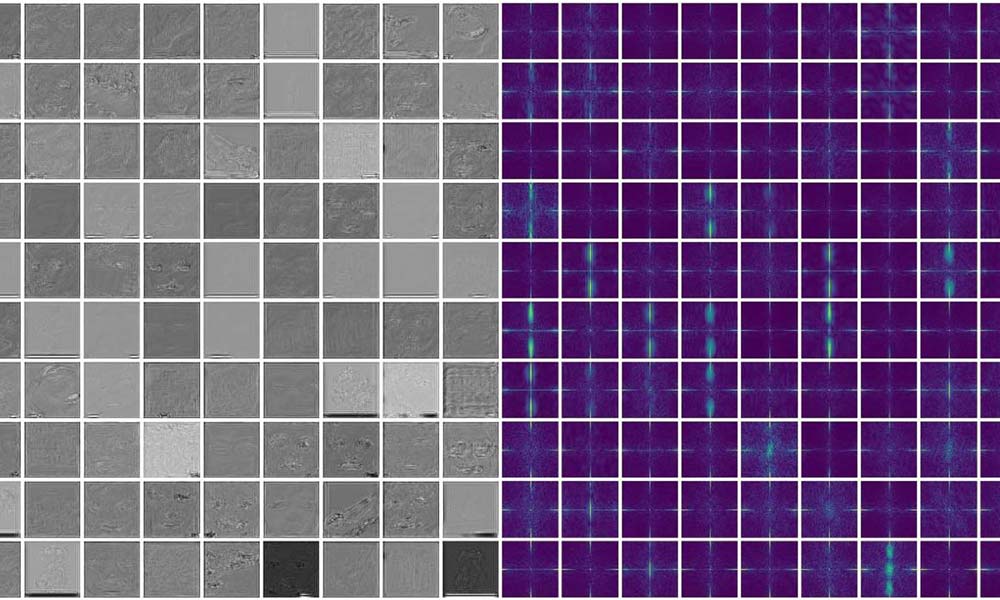

Facebooks Forscher wendeten diesen "Reverse Engineering"-Ansatz für die Deepfakes-Erkennung an: Sie lassen das potenzielle Deepfake-Bild durch ein sogenanntes Fingerabdruck-Schätzungsnetzwerk (FEN) laufen, das im Bild kleinste Spuren des Modells aufspüren soll, mit dem das Bild erzeugt wurde. Die Fingerabdruck-Schätzung berücksichtigt Faktoren wie Größe eines Fingerabdrucks, sich wiederholende Strukturen darin, den Frequenzbereich und den symmetrischen Frequenzgang.

KI lernt feinste Deepfake-Muster

Die Forscher trainierten ihren Erkennungsalgorithmus unüberwacht (Erklärung) anhand eines selbst zusammengestellten Datensatzes mit Fingerabdrücken von aktuell bekannten Deepfake-Modellen. Nach dem KI-Training konnte der Algorithmus auch generative Modelle identifizieren, die nicht Teil des Trainingsdatensatzes waren.

"Wenn es sich um ein neues KI-Modell handelt, das niemand zuvor gesehen hat, dann gab es sehr wenig, was wir in der Vergangenheit darüber hätten sagen können. Jetzt können wir sagen: 'Schaut, das Bild, das hier hochgeladen wurde, das Bild, das dort hochgeladen wurde, sie alle stammen von demselben Modell'", erklärt Hasner gegenüber The Verge.

Facebooks Forscher beschreiben ihre Erkennungsrate als signifikant besser als Zufall und auf Augenhöhe mit anderen aktuellen Erkennungsmethoden. Die Methode soll außerdem auf jede Art von Deepfake-Fälschung wie zum Beispiel Textersatz angewandt werden können, generalisiert also besser als bisher bekannte Methoden für die Gesichtserkennung.

Facebooks KI-Forschung veröffentlichen den eigenen Code und das trainierte KI-Modell bei Github. Im Zuge der Forschungsarbeit erstellte Facebook zusätzlich einen Katalog mit derzeit 100 unterschiedlichen existierenden Deepfake-Modellen.

Ob und wann der entwickelte Deepfake-Erkennungsalgorithmus bei Facebook-Plattformen eingesetzt werden könnte, ist laut Hasner noch nicht einmal in Diskussion.

Deepfake-Erkennung bleibt ein Katz-und-Maus-Spiel

Die besondere Herausforderung bei Deepfakes ist allerdings, dass die Vielfalt an generativen KI-Modellen deutlich größer ist als bei der von Hasner verwendeten Kamera-Analogie und dass Mischmethoden verschiedener Fälschungsmethoden möglich sind.

Noch dazu wächst die Auswahl an generativen Modellen ständig, die Technologie entwickelt sich rasant. Und Facebook testete den eigenen Algorithmus nur anhand der eigenen Datensätze - welche Deepfake-Erkennungsrate er dauerhaft außerhalb von Laborbedingungen erzielen kann, ist nicht abzusehen.

Ob die großen Social-Plattformen wie Facebook oder YouTube das Katz-und-Maus-Spiel bei der Deepfakes-Erkennung für sich entscheiden können, ist daher offen. Der KI-Forscher Hao Li geht davon aus, dass Deepfakes über kurz oder lang visuelle Perfektion erreichen und dann keine von außen mehr erkennbare Spuren enthalten, schlicht und ergreifend nicht mehr von einem Original zu unterscheiden sind - selbst vom besten Algorithmus nicht.

Quellen: Facebook AI, CNBC; Titelbild: Facebook AI

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.