Nvidia stellt verbesserte Deepfake-Technologie vor

Nvidia stellt ein KI-Modell vor, das bisher typische Artefakte in Deepfake-Videos vermeidet und die KI-Videotechnik so auf eine neue Stufe hebt.

KI-Systeme für die Bildgenerierung haben in den letzten Jahren große Fortschritte erzielt. Nvidias StyleGAN generiert etwa Gesichter, die kaum noch von echten zu unterscheiden sind. Die dafür eingesetzten GANs (Generative Adversarial Network) kommen auch für Deepfakes zum Einsatz.

Die nächste Entwicklung sollen laut Nvidia-Forschern GAN-basierte Systeme sein, die ihre Kreationen nachträglich weiter bearbeiten können, etwa einen künstlichen Kopf in eine andere Position drehen oder lächeln lassen.

StyleGAN sollte das eigentlich bereits beherrschen, doch in der Praxis kommt es zu seltsamen Artefakten: Texturen auf der Nase kleben wie fixiert an Ort und Stelle, während sich das Gesicht dreht oder Haare wabern surreal auf dem Kopf. Das bricht die Illusion eines zusammenhängenden Gesichts, das sich durch den Raum bewegt.

Alias-Effekt verhindert glaubwürdige Videos

Nun haben die Nvidia-Forscher die Ursache gefunden: Die Position feiner Details wie Hautporen wird nicht von gröberen Details wie der Position der Nase bestimmt. In StyleGAN sind die feinen Details stattdessen auf bestimmte Pixelkoordinaten fixiert. Das liege an Alias-Effekten, die beim Hochskalieren des generierten Bilds innerhalb des GANs auftreten, schreiben die Forscher.

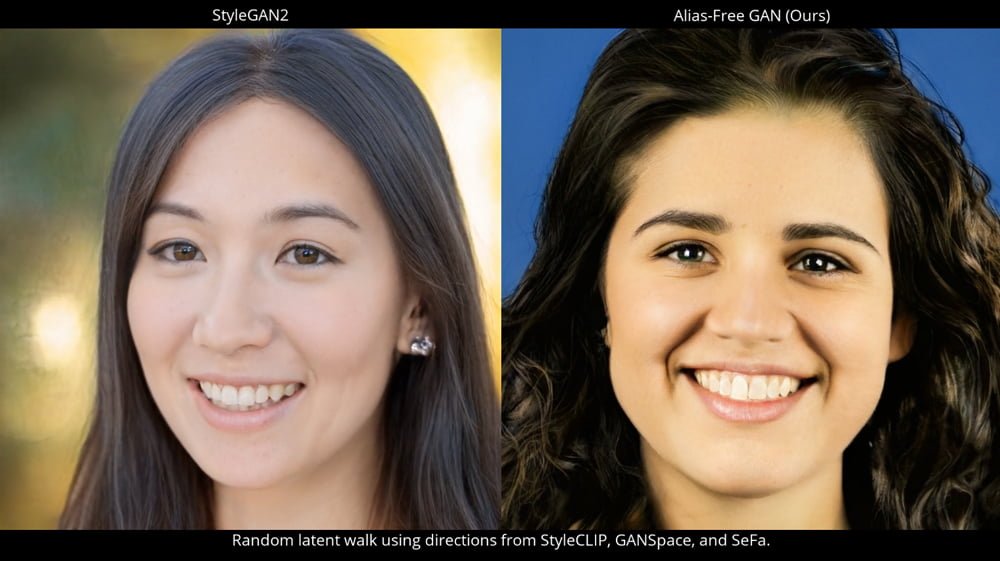

Video: Links ist StyleGAN2 zu sehen, rechts das neue Netz. Besonders am linken Bart wird deutlich, wie sich die feinen Details an Pixelkoordinaten orientieren statt an der tatsächlichen Position im Gesicht. Im rechten Video ist dieser Effekt beseitigt.

Im Alias-Free GAN hat Nvidia nun diesen Effekt unter anderem mit einem stärkeren Alias-Filter entfernt. Das Ergebnis ist ein KI-System, das qualitativ hochwertige Bilder generiert und feine Details wie Poren auch bei Bewegungen konsistent an ihrer natürlichen Position wie der Nase hält.

Weitere Verbesserungen an GANs möglich

Laut der Nvidia-Forscher sind die Verbesserungen lediglich im Generator des GANs vorgenommen worden. Weitere Veränderungen seien wohl im Diskriminator des Netzes möglich. Das könne übrig gebliebene Artefakte wie Fehler in den Zähnen verhindern, vermuten die Forscher. Doch auch ohne diese Verbesserungen lege Alias-Free GAN die Grundlage für generative Systeme, die besser für Videos und Animationen geeignet seien.

Die Entfernung charakteristischer Artefakte aus KI-generierten Videos mache diese jedoch auch schwerer als manipuliert erkennbar, warnen die Forscher. Sie schlagen vom KI-Modell eingefügte Wasserzeichen und weitreichende Authentizitätsprüfungen auf Social-Media-Plattformen als mögliche Lösungen vor. Unter anderem arbeitet Facebook an Deepfake-Erkennungssystemen.

Ein vortrainiertes KI-Modell und weitere Details zu Alias-Free GAN sollen im September auf GitHub veröffentlicht werden.

Quelle: Nvidia | Titelbild: Nvidia

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.